Compare los cerebros con las computadoras es una analogía larga y muy apreciada tanto en la neurociencia como en la informática.

No es difícil ver por qué.

Nuestro cerebro puede realizar muchas de las tareas que queremos que las computadoras manejen con una gracia fácil y misteriosa. Por lo tanto, comprender el funcionamiento interno de nuestra mente puede ayudarnos a construir mejores computadoras ; y esas computadoras pueden ayudarnos a comprender mejor nuestras propias mentes. Además, si los cerebros son como las computadoras, saber cuántos cálculos se necesitan para hacer lo que hacen puede ayudarnos a predecir cuándo las máquinas coincidirán con las mentes.

De hecho, ya existe un flujo productivo de conocimiento entre los campos.

El aprendizaje profundo, una forma poderosa de inteligencia artificial , por ejemplo, se modela vagamente en las vastas redes de neuronas en capas del cerebro.

Puede pensar en cada “nodo” de una red neuronal profunda como una neurona artificial. Al igual que las neuronas, los nodos reciben señales de otros nodos conectados a ellos y realizan operaciones matemáticas para transformar la entrada en salida.

Dependiendo de las señales que reciben un nodo, puede optar por enviar su propia señal a todos los nodos de su red. De esta manera, las señales caen en cascada a través de una capa tras otra de nodos, ajustando y afinando progresivamente el algoritmo.

El cerebro también funciona así. Pero la palabra clave anterior es vaga.

Los científicos saben que las neuronas biológicas son más complejas que las neuronas artificiales empleadas en los algoritmos de aprendizaje profundo, pero es una pregunta abierta cuánto más complejas.

En un fascinante artículo publicado recientemente en la revista Neuron , un equipo de investigadores de la Universidad Hebrea de Jerusalén intentó acercarnos un poco más a la respuesta. Si bien esperaban que los resultados mostraran que las neuronas biológicas son más complejas, se sorprendieron de lo mucho más complejas que son en realidad.

En el estudio, el equipo descubrió que se necesita una red neuronal de cinco a ocho capas, o casi 1.000 neuronas artificiales, para imitar el comportamiento de una sola neurona biológica de la corteza cerebral.

Aunque los investigadores advierten que los resultados son un límite superior para la complejidad, en el lugar de una medición exacta de la misma, también creen que sus hallazgos podrían ayudar a los científicos a concentrarse más en lo que hace que las neuronas biológicas sean tan complejas. Y ese conocimiento, tal vez, pueda ayudar a los ingenieros a diseñar redes neuronales e inteligencia artificial aún más capaces.

“[El resultado] forma un puente entre las neuronas biológicas y las neuronas artificiales”, dijo a Quanta Andreas Tolias, neurocientífico computacional de la Facultad de Medicina de Baylor, a Quanta la semana pasada.

Cerebros asombrosos

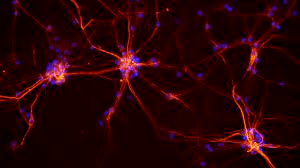

Las neuronas son las células que forman nuestro cerebro. Hay muchos tipos diferentes de neuronas, pero generalmente tienen tres partes: estructuras delgadas y ramificadas llamadas dendritas, un cuerpo celular y un axón en forma de raíz.

En un extremo, las dendritas se conectan a una red de otras neuronas en uniones llamadas sinapsis. En el otro extremo, el axón forma sinapsis con una población diferente de neuronas. Cada célula recibe señales electroquímicas a través de sus dendritas, filtra esas señales y luego pasa selectivamente a lo largo de sus propias señales (o picos).

Para comparar computacionalmente neuronas biológicas y artificiales, el equipo preguntó: ¿Qué tamaño de red neuronal artificial se necesitaría para simular el comportamiento de una sola neurona biológica?

Primero, construyeron un modelo de neurona biológica (en este caso, una neurona piramidal de la corteza de una rata). El modelo utilizado unas 10.000 ecuaciones diferenciales para simular cómo y cuándo la neurona traduciría una serie de señales de entrada en un pico propio.

Luego, introdujeron entradas en su neurona simulada, registraron las salidas y entrenaron algoritmos de aprendizaje profundo en todos los datos. ¿Su meta? Encontrar el algoritmo que podría aproximar el modelo con mayor precisión.

(Video: Un modelo de una neurona piramidal (izquierda) recibe señales a través de sus ramas dendríticas. En este caso, las señales provocan tres picos).

Aumentaron el número de capas en el algoritmo hasta que tuvo una precisión del 99 por ciento en la predicción de la salida de la neurona simulada dado un conjunto de entradas. El punto óptimo eran al menos cinco capas pero no más de ocho, o alrededor de 1.000 neuronas artificiales por neurona biológica. El algoritmo de aprendizaje profundo era mucho más simple que el modelo original, pero aún bastante complejo.

¿De dónde surge esta complejidad?

Resulta que se debe principalmente a un tipo de receptor químico en las dendritas, el canal iónico NMDA, y la ramificación de las dendritas en el espacio. “Si se quita una de esas cosas, una neurona se convierte [en] un dispositivo simple”, tuiteó el autor principal, David Beniaguev, en 2019 , describiendo una versión anterior del trabajo publicado como una preimpresión.

De hecho, después de eliminar estas características, el equipo descubrió que podía hacer coincidir el modelo biológico simplificado con un algoritmo de aprendizaje profundo de una sola capa.

Un punto de referencia en movimiento

Es tentador extrapolar los resultados del equipo para estimar la complejidad computacional de todo el cerebro. Pero no estamos ni cerca de tal medida.

Por un lado, es posible que el equipo no haya encontrado el algoritmo más eficiente.

Es común que la comunidad de desarrolladores mejore rápidamente la primera versión de un algoritmo de aprendizaje profundo avanzado. Dada la intensa iteración en el estudio, el equipo confía en los resultados, pero también entregaron el modelo, los datos y el algoritmo a la comunidad científica para ver si alguien podía hacerlo mejor.

Además, la neurona modelo proviene del cerebro de una rata, a diferencia del de un humano, y es solo un tipo de célula cerebral. Además, el estudio está comparando un modelo con un modelo; hasta el momento, no hay forma de hacer una comparación directa con una neurona física en el cerebro. Es muy posible que lo real sea más complejo, no menos.

Aún así, el equipo cree que su trabajo puede impulsar la neurociencia y la inteligencia artificial.

En el primer caso, el estudio es una prueba más de que las dendritas son criaturas complicadas que merecen más atención. En este último, puede conducir a arquitecturas algorítmicas nuevas y radicales.

Idan Segev, coautor del artículo, sugiere que los ingenieros deben intentar reemplazar las neuronas artificiales simples en los algoritmos actuales con una mini red de cinco capas que simula una neurona biológica. “Pedimos el reemplazo de la tecnología de red profunda para acercarla a cómo funciona el cerebro al reemplazar cada unidad simple en la red profunda hoy con una unidad que representa una neurona, que ya es, por sí misma, profunda”, Segev dijo.

Es incierto si tanta complejidad adicional valdría la pena. Los expertos debaten cuánto de los algoritmos de detalle del cerebro necesitan capturar para lograr resultados similares o mejores.

Pero es difícil discutir con millones de años de experimentación evolutiva. Hasta ahora, seguir el modelo del cerebro ha sido una estrategia gratificante. Y si este trabajo es un indicio, las redes neuronales del futuro pueden empequeñecer en tamaño y complejidad a las de hoy.

Fuente:

Dorrier, J. (2021e, 12 de septiembre). Un nuevo estudio encuentra que una sola neurona es una pequeña computadora sorprendentemente compleja. Recuperado 15 de septiembre de 2021, de https://singularityhub.com/2021/09/12/new-study-finds-a-single-neuron-is-a-surprisingly-complex-little-computer/