Google ha presentado su proyecto Parrotron, una red neuronal de extremo a extremo que transforma patrones de habla atípicos en un lenguaje sintetizado y fluido, y que esta dirigido a personas con discapacidades del habla, según informa la compañía en su blog corporativo.

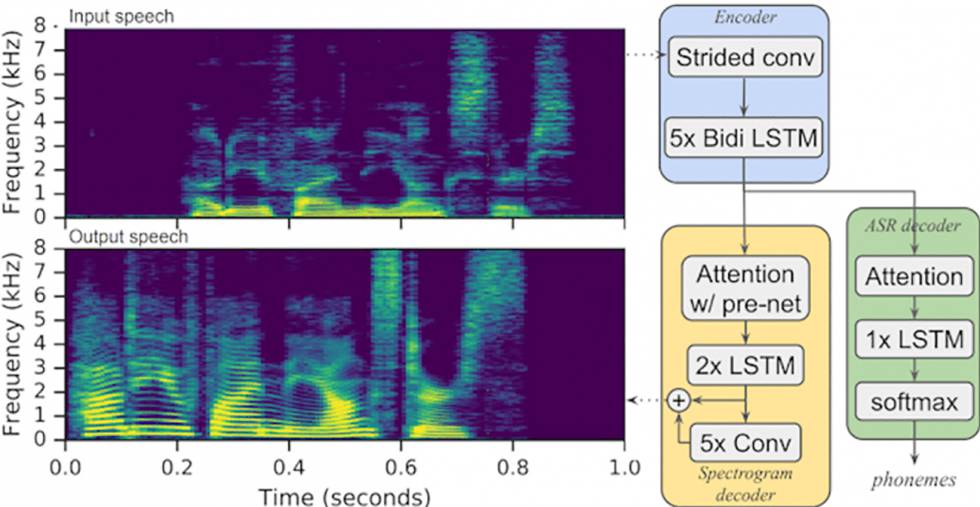

El proyecto Parrotron está centrado en el habla, y logra este proceso sin la necesidad de producir texto y omitiendo el paso de reconocimiento de señales del lenguaje (como el movimiento de los labios). El objetivo es que esta tecnología se pueda emplear entre humanos y con motores de reconocimiento de lenguaje automático (ASR, por sus siglas en inglés).

Esta herramienta es parte del proyecto Euphonia, que, según Google, ha demostrado “que los modelos de reconocimiento de voz pueden mejorarse significativamente para transcribir mejor una variedad de habla atípica y disártrica”. Google, así, ha partido de los asistentes virtuales y servicios de reconocimiento de voz, herramientas que estas personas no puden usar debido a sus dificultades.

Como explica Google en un comunicado publicado en su blog de Inteligencia Artificial, Parrotron ha sido entrenado en dos fases utilizando dos recopilaciones paralelas de pares de voz de entrada/salida.

Para ello, los investigadores construyeron un modelo de conversión de voz a voz para el habla fluida estándar. Posteriormente personalizaron el modelo, adaptándolo a los patrones de voz atípicos de la persona con dificultades. Recurrieron a datos paralelos derivados automáticamente con un sistema de síntesis de voz a texto (TTS). Un sistema text-to-speech (TTS) convierte el lenguaje de texto normal en habla; otros sistemas recrean la representación simbólica lingüística como transcripciones fonéticas en habla. Una de las personas más famosas que han usado estos sistemas ha sido el científico Stephen Hawking.

Google desarrolló varias pruebas del sistema Parrotron, entre ellas, una con un investigador y matemático de Google, Dimitri Kanevsky, de origen ruso y profundamente sordo, de padres con audición normal, y con Aubrie Lee, una defensora de la inclusión de discapacitados que tiene una distrofia muscular.

En el caso de Dimitri, se grabaron 15 horas de discurso, que se utilizaron para adaptar el modelo base a los matices específicos de su discurso. El sistema Parrotron le ayudó a ser comprendido tanto por los investigadores como por el sistema ASR de Google por igual. El funcionamiento del motor ASR de Google en la salida de Parrotron redujo significativamente la tasa de error de palabra del 89% al 32%.

Aubrie, por su parte, aportó 1,5 horas de grabaciones de voz que han sido claves para ejemplificar el exito esta tecnología de voz.

Fuente: Retina EL Pais