Los científicos del Instituto Neurológico de Montreal han utilizado el Big Data para identificar a la disminución en el suministro de sangre en el cerebro como el posible primer signo de la aparición de la enfermedad de Alzheimer.

El Big Data, metadatos o datos masivos es un concepto que hace referencia al almacenamiento de grandes cantidades de datos y a los procedimientos usados para encontrar patrones repetitivos dentro de esos datos.

Actualmente la enfermedad de Alzheimer es la forma más común de demencia entre las personas mayores de 65 años. Se consideraba que su inicio estaba relacionada con la deposición de altas concentraciones de proteína beta amiloide en el cerebro, la cual ataca las sinapsis de las neuronas, causando su muerte y destruyendo la memoria.

Tan solo en los Estados Unidos, la enfermedad de Alzheimer afecta a unos 5 millones de personas mayores de 65 años (1 de cada 9). Sin embargo, la Asociación de Alzheimer predice que para el año 2050, este número ascenderá a un alarmante 13.8 millones de personas mayores de 65 años (1 de 4).

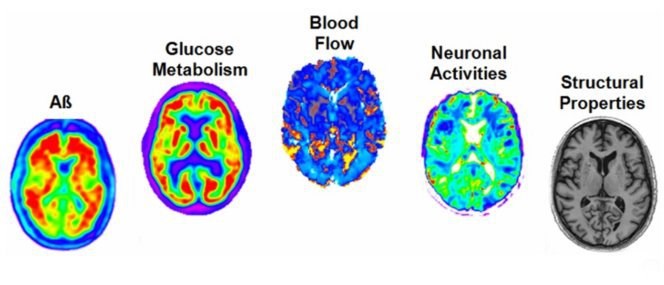

En el estudio los investigadores utilizaron 7 mil 700 imágenes cerebrales de mil 171 personas en diversas etapas de progresión de la enfermedad, donde usaron una variedad de técnicas que incluyeron imágenes por resonancia magnética, tomografía por emisión de positrones, análisis de sangre y de líquido cefalorraquídeo, así como el nivel de la cognición de los sujetos.

En los resultados las concentración de amiloides, el metabolismo de la glucosa, el flujo sanguíneo cerebral, la actividad funcional y la atrofia cerebral en 78 regiones del cerebro, son todos factores que fueron considerados en la investigación, donde a pesar de que el papel de las proteínas amiloides sigue siendo críticas, la evolución en la irrigación sanguínea es muy importante a considerar, ya que es un signo que aparece antes, encontraron los investigadores.

La trayectoria de cada factor biológico se registró utilizando los datos de cada paciente durante un periodo de 30 años. Ese proceso se reprodujo luego 500 veces para mejorar la robustez de las estimaciones y la estabilidad de los resultados.

Ahora los investigadores esperan profundizar su estudio mediante la realización de una modelización de las causas más completa, en la que se analiza cada mecanismo. Pero para hacer eso, hará falta todavía más estudiossíntesis guiados por los datos, dijo Yasser Iturria Medina, autor principal del estudio.